La nuova app AI deepfake crea immagini di donne nude in pochi secondi

I falsi risultanti potrebbero essere usati per vergognare, molestare e intimidire i loro obiettivi

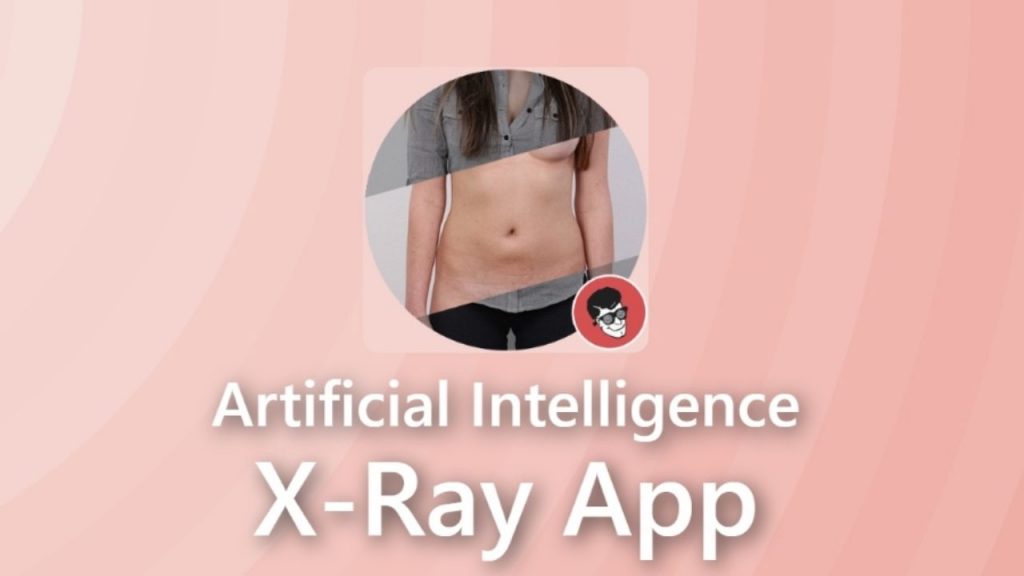

L’app DeepNude crea falsi AI con un clic di un pulsante.

Un nuovo strumento software basato su AI rende facile per chiunque generare immagini nude realistiche di donne semplicemente fornendo al programma un’immagine del bersaglio desiderato indossando abiti.

L’app si chiama DeepNude ed è l’ultimo esempio di deepfakes generati dall’IA utilizzati per creare immagini compromettenti di donne ignare. Il software è stato individuato per la prima volta da Samantha Cole di Motherboard ed è disponibile per il download gratuito per Windows, con una versione premium che offre immagini con una migliore risoluzione disponibile per $ 99.

( Aggiornamento: l’app è stata ritirata più tardi nella giornata di giovedì, ore dopo che l’attenzione è stata attirata su di esso .)

I NUDI FINTI NON SONO PERFETTI MA POTREBBERO FACILMENTE ESSERE SCAMBIATI PER LA COSA REALE

Entrambe le versioni gratuite e premium dell’applicazione aggiungono filigrane ai nudi generati dall’IA che li identificano chiaramente come “falsi”. Ma nelle immagini create da Motherboard , questa filigrana è facile da rimuovere. (Non siamo stati in grado di testare l’app da soli perché i server sono stati sovraccaricati apparentemente).

Un esempio di output dall’app, con barre di censura aggiunte da The Verge .

Come abbiamo visto con esempi precedenti di pornografia deepfake, la qualità dell’output è varia. Non è certamente fotorealistico, e se esaminato da vicino le immagini sono facili da individuare come false. La carne dell’IA è sfocata e pixelata e il processo funziona meglio su immagini ad alta risoluzione quando l’obiettivo indossa già abiti rivelatori come un costume da bagno.

Ma a risoluzioni inferiori – o se viste solo brevemente – le immagini fasulle sono facili da confondere con la realtà e potrebbero causare danni indicibili alla vita delle persone.

Sebbene gran parte della discussione sui potenziali danni dei deepfakes si sia incentrata sulla disinformazione politica e sulla propaganda, l’uso di questa tecnologia per colpire le donne è stata una costante dalla sua creazione. In effetti, è stato così che la tecnologia si è diffusa per la prima volta , con gli utenti di Reddit che hanno adattato la ricerca sull’intelligenza artificiale pubblicata dagli accademici per creare finta pornografia celebrità.

Un recente rapporto di HuffPost ha evidenziato come il fatto di essere preso di mira dalla pornografia e dai nudi deepfake può rovinare la vita di qualcuno. Come per la vendetta porno, queste immagini possono essere usate per vergognare, molestare, intimidire e mettere a tacere le donne. Ci sono forum in cui gli uomini possono pagare esperti per creare deepfakes di colleghi, amici o familiari, ma strumenti come DeepNude rendono facile la creazione di tali immagini in privato e con il semplice tocco di un pulsante.

In particolare, l’app non è in grado di produrre immagini di uomini nudi. Come riportato da Motherboard , se si alimenta un’immagine di un uomo si aggiunge semplicemente una vulva.