L’auditing di ‘Rekognition’ di Amazon potrebbe rimuovere il bias

Questa mossa aiuterà a sollevare dubbi sul fatto che Amazon stia esacerbando la profilazione e il pregiudizio razziale?

Il gigante dell’e-commerce Amazon sta finalmente intensificando gli sforzi per verificare il suo strumento di riconoscimento facciale AI che è stato definito come un errore sistematico. Progettano di collaborare con l’Istituto nazionale degli standard e della tecnologia (NIST) per sviluppare test standardizzati su questo problema e migliorare l’accuratezza. Questa mossa aiuterà a sollevare dubbi sul fatto che Amazon stia esacerbando la profilazione e il pregiudizio razziale?

Il guasto che devi sapere

Amazon ha venduto il suo programma di riconoscimento facciale ai dipartimenti di polizia degli Stati Uniti da parecchio tempo ormai. CultureBanx ha osservato che la ricerca mostra che i sistemi di intelligenza artificiale commerciale tendono ad avere tassi di errore più elevati per le donne e le persone di colore. Alcuni sistemi di riconoscimento facciale confondevano gli uomini con la pelle chiara solo lo 0,8% delle volte e avrebbero un tasso di errore del 34,7% per le donne con pelle scura.

Questo è il primo tentativo di Amazon di collaborare con un laboratorio sostenuto dal governo per sviluppare test. Lavorando con un’organizzazione come il NIST , il leader del settore per il riconoscimento facciale forse mostra finalmente che si preoccupano del danno di cui è capace la tecnologia. Ottenere uno strumento centrale che valuti l’efficacia di tutti i prodotti di riconoscimento facciale è vitale per eliminare i pregiudizi.

“Accogliamo con favore l’opportunità di lavorare con NIST per migliorare i loro test contro questa API in modo obiettivo e per stabilire set di dati e benchmark con la più ampia comunità accademica”, ha scritto Amazon in una dichiarazione. Il NIST ha pubblicato tre rapporti sul software di riconoscimento facciale a partire dal 2010, con un database di oltre 26 milioni di foto.

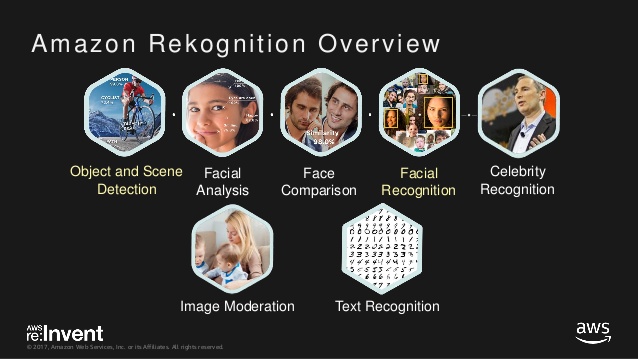

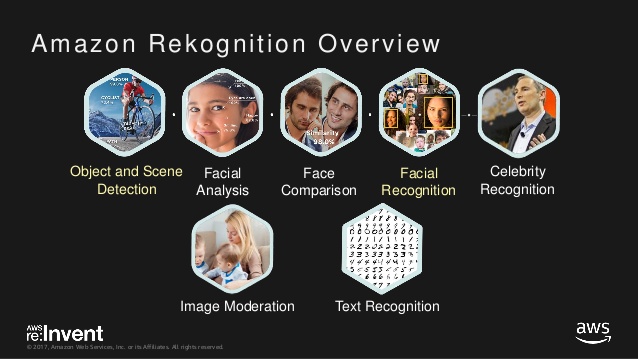

Sarà interessante vedere come Amazon prevede di sviluppare un unico test adatto a tutti, perché il suo Rekognition non può essere “scaricato” per i test al di fuori di AWS. Questo è qualcosa che dovrebbe accadere al fine di ottenere risultati indipendenti che riflettano accuratamente come i potenziali clienti utilizzerebbero il servizio nel mondo reale.

Mentre i critici chiedono giustificazione per l’uso della tecnologia e in alcuni casi un divieto totale, l’intelligenza artificiale continua ad essere un’industria da miliardi di dollari. Un rapporto pubblicato da Market Research Future ha rilevato che il mercato globale per il riconoscimento facciale supererà una valutazione di $ 8 miliardi nel 2022 da $ 3,04 miliardi nel 2016. Si aspetta che il settore si espanda ad un impressionante tasso di crescita annuale del 19,68%.

Altre società come il gigante tecnologico IBM vogliono allenare meglio i sistemi di riconoscimento facciale per aumentare la diversità e ridurre i pregiudizi. Hanno pubblicato un nuovo set di dati, Diversity in Faces, con la speranza che possa aiutare gli sviluppatori a combattere i pregiudizi di genere e di tipo di pelle.

L’IA deve essere diretta su come interpretare e utilizzare i dati per stabilire un risultato. Se i dati presentati non includono informazioni sufficienti per uno sfondo particolare (es. Nero, Latinox), il risultato non è altrettanto affidabile. I dipartimenti di polizia di tutta l’America lottano ancora per migliorare i rapporti con la comunità nera. Gli afroamericani sono già stati incarcerati 5 volte di più rispetto ad altre razze. Le donne nere sono incarcerate al doppio del tasso delle loro controparti.